Según declaró Claudio Orrego, intendente de la ciudad de Santiago, en diciembre de este año el Estado chileno adquirirá un software de reconocimiento facial para ser utilizado en el control de la violencia en los estadios y “con motivo de otros temas de seguridad del Estado”, por ejemplo el control de marchas y manifestaciones. Este sistema contará con los datos del Servicio de Registro Civil e Identificación, una base de datos que cuenta con las fotografías y la información personal de 17 millones de ciudadanos, y será manejado por una oficina central de la policía, quienes estarán a cargo de contrastar las imágenes tomadas por las cámaras de vigilancia contra la inmensa base de datos, a través del software especializado.

Por supuesto, Chile no es el primer país en implementar tecnologías de reconocimiento facial con finalidades de preservación del orden público. Sin ir muy lejos, el gobierno de los Estados Unidos utiliza estas tecnologías desde hace varios años, y se estima que uno de cada cuatro de sus departamentos policiales en al menos 26 estados tienen acceso a una base de datos que, a la fecha, contendría los rostros y datos personales de al menos la mitad de los ciudadanos. En Colombia, las autoridades comenzaron a implementar el año pasado el uso del software Face First en el sistema de transporte público urbano, con la finalidad de enviar alertas a través de las diferentes estaciones, así como a otros sitios, como estadios de fútbol.

Investigadores especializados han señalado que, a pesar de que esta tecnología pueda ser útil para ayudar a localizar a criminales violentos, existen riesgos implícitos en los posibles usos que pueda dársele. Por ejemplo, su utilización en protestas y manifestaciones (como ha ocurrido en Brasil y como ocurriría en Chile) podría comprometer las libertades básicas, incluyendo la libertad de expresión y manifestación, que incluye el derecho a expresarse anónimamente.

La tecnología de reconocimiento facial funciona a través de un análisis de diversos rasgos físicos, incluyendo factores como las dimensiones del rostro, la forma de los pómulos, el ancho de la nariz y la longitud de la frente. Con esta información, busca coincidencias en la base de datos hasta encontrar una o más personas cuyo perfil corresponda a los rasgos identificados. Sin embargo, un estudio reciente de la Universidad de Georgetown encontró evidencia de que el software de reconocimiento facial presenta fallas cuando la iluminación varía, y no funciona de manera precisa con personas de piel oscura, lo que resultaría en un mayor número de personas inocentes siendo indebida e innecesariamente detenidas.

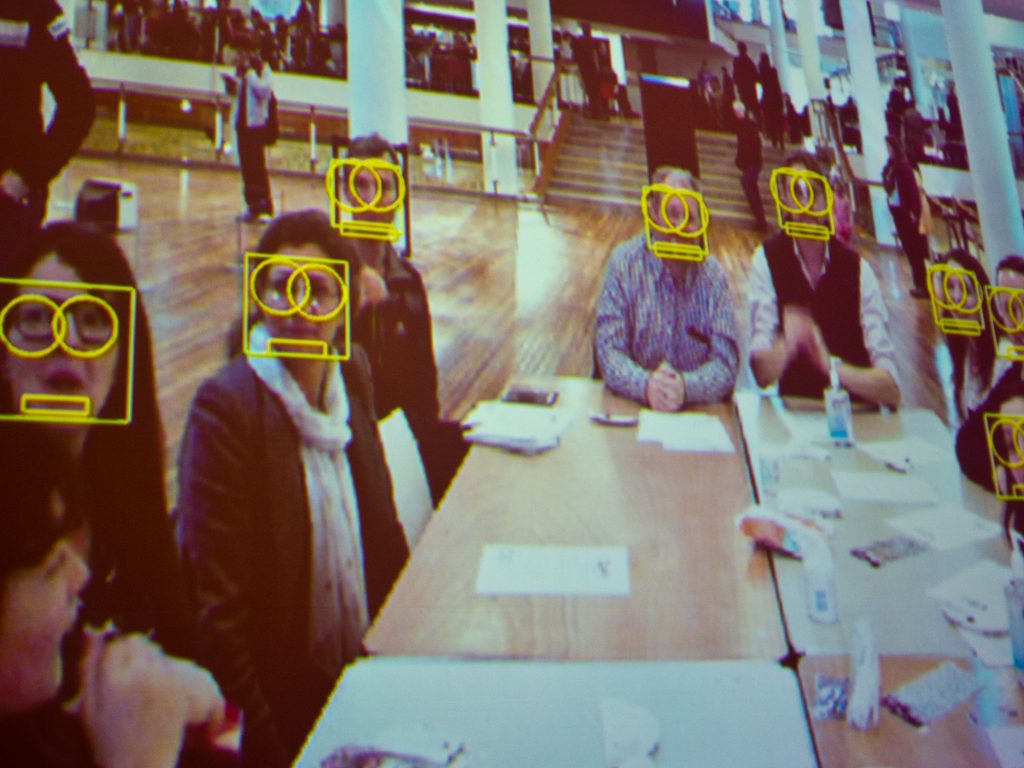

Del mismo modo, con bases de datos de poblaciones amplias, es inevitable el surgimiento de falsas coincidencias. En casos como el de Steve Talley, quien ha sido reiteradamente apresado por errores en el sistema de reconocimiento facial, las implicaciones para los derechos humanos más básicos son obvias, y ponen en evidencia el principal problema de todas las tecnologías de autenticación biométrica: la dificultad de cambiar un rostro o una huella digital, una vez que este ha sido comprometido como mecanismo de reconocimiento. Por otra parte, para una persona consciente de que está siendo vigilada, es relativamente fácil engañar a una cámara, y esto ha dado lugar al surgimiento de una serie de acciones, algunas más cercanas a la protesta y otras al performance artístico, que buscan mecanismos para escapar a la vigilancia; en ocasiones, basta con utilizar los anteojos adecuados.

Si bien algunos alegan que los problemas inherentes al reconocimiento facial pueden ser minimizados a través de un grado mínimo de intervención humana, el cual evitaría que el reconocimiento automatizado produjera falsos positivos, en otros casos el sesgo humano podría profundizar las fallas de la tecnología. Los falsos positivos terminan por forzar a los ciudadanos a probar que no son culpables, invirtiendo la carga de la prueba incluso antes de que comience el proceso y subvirtiendo así el principio básico de la presunción de inocencia. Cualquier implementación de un sistema biométrico de vigilancia debe, pues, partir de la presunción de que todo software puede fallar, y del establecimiento de estándares básicos de protección de los derechos humanos para evitar que estas fallas afecten negativamente las libertades y garantías ciudadanas.

Comisión Interamericana de Derechos Humanos

Comisión Interamericana de Derechos Humanos LACIGF

LACIGF Vigilancia global

Vigilancia global